今回は、「生成AIの弱点が相次ぎ発覚 ChatGPTやGeminiがサイバー攻撃の標的に 情報流出や不正操作の恐れも」というニュースです。

詳しいことは以下をご覧ください。

米OpenAIの「ChatGPT」やGoogleの「Gemini」など、主要生成AIの弱点や脆弱性が次々に発覚している。企業や個人の日常生活に浸透している生成AIが悪用されれば、社外秘情報や個人情報の流出を招いたり、悪用防止対策がかわされて偽情報の作成に利用されたりする恐れもある。

私も日々サイトの記事作成などで利用しているので、紹介しておくことにしました。

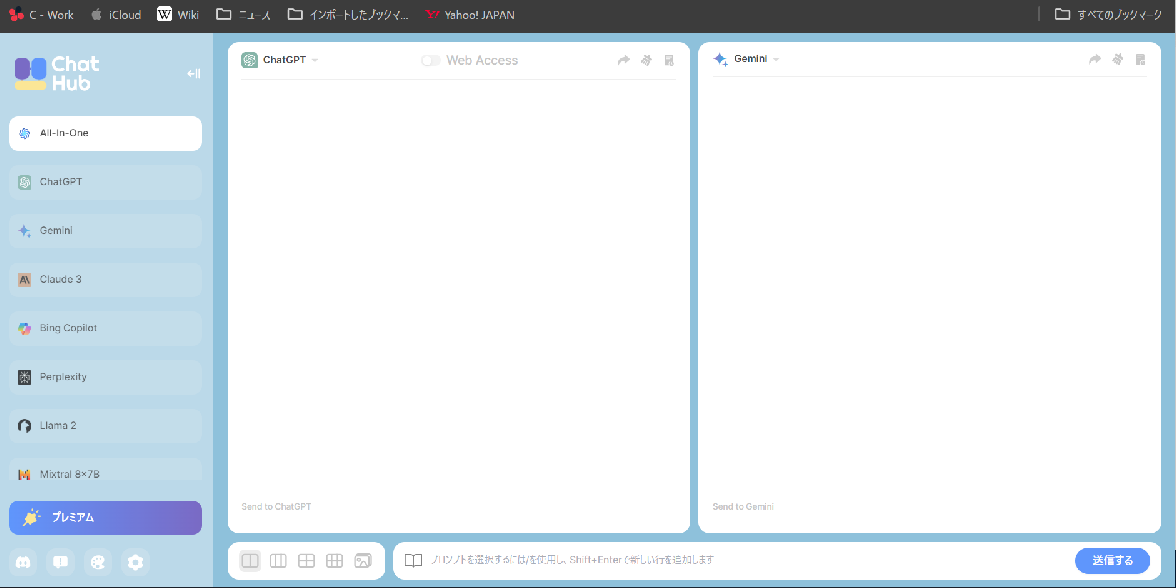

そこで、ChatGPTとGeminiに聞いてみることにしました。

ポンコツPCを開きChatGPTとGeminiが表示されています。

ここで同時に同じ質問をしてみました。

質問内容は、「「生成AIの弱点が相次ぎ発覚 ChatGPTやGeminiがサイバー攻撃の標的に 情報流出や不正操作の恐れも」という、ニュースを読みましたが、感想を教えてください。 」です。

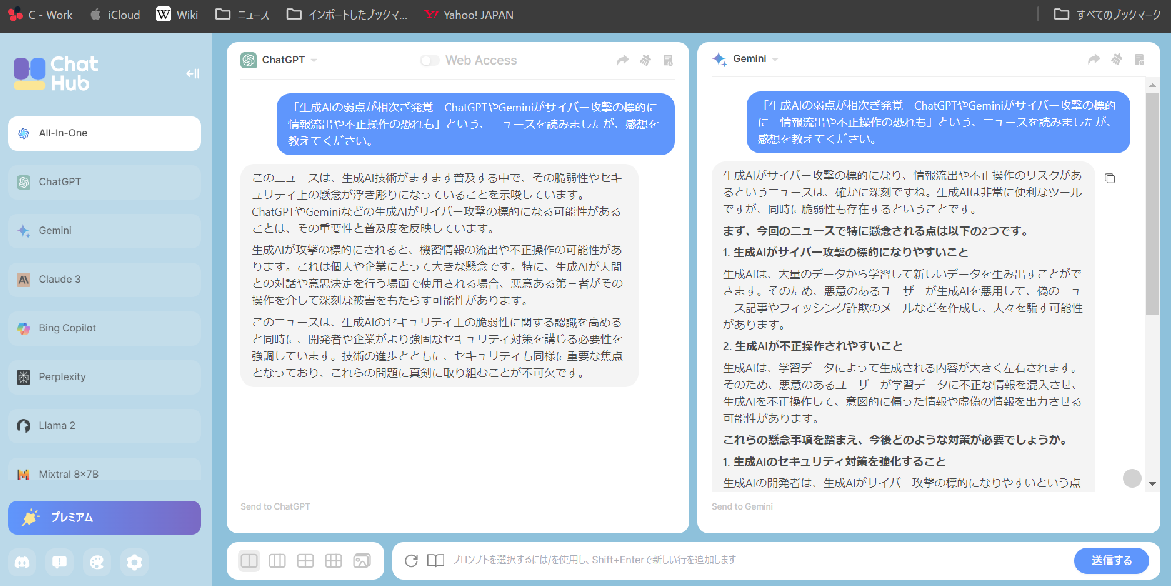

帰ってきた回答は以下の通り。

読みずらいですね。

ChatGPTの回答は、

続いてGeminiの回答です。

確かに、生成AIは非常に便利なツールですが、同時に多くの弱点を抱えていることも事実です。今回のニュースは、その弱点が実際に悪用され始めていることを示しており、非常に深刻な問題だと感じています。

具体的には、以下の点に懸念を抱いています。

1. 情報流出 生成AIは、学習データに含まれるあらゆる情報を文章や画像として生成することができます。そのため、悪意のあるユーザーが生成AIを悪用すれば、企業の機密情報や個人情報などを簡単に流出させてしまう可能性があります。

2. 不正操作 生成AIは、人間の言葉を巧みに操る能力も持ち合わせています。そのため、悪意のあるユーザーが生成AIを悪用すれば、人々を騙して金銭を詐取したり、不正なアクセスを誘導したりする可能性があります。

3. 社会への悪影響 生成AIは、差別的な表現やヘイトスピーチを含む文章や画像を生成することも可能です。こうした内容が拡散されることで、社会の分断や対立がさらに深刻化してしまう可能性があります。

これらの問題を解決するためには、以下のような対策が必要だと考えられます。

1. 生成AIのセキュリティ対策の強化 生成AIの開発・運用者は、サイバー攻撃に対してより強固なセキュリティ対策を講じる必要があります。具体的には、学習データの管理を徹底したり、生成される内容を厳格にチェックしたりする必要があります。

2. 利用者への教育 生成AIの利用者には、その仕組みやリスクを理解してもらう必要があります。具体的には、生成AIが生成した内容を鵜呑みにせず、常に批判的に判断する姿勢が必要になります。

3. 法的な規制 生成AIの悪用を防ぐためには、法的な規制も必要かもしれません。例えば、差別的な表現やヘイトスピーチを含む内容を生成することを禁止する法律などが考えられます。 生成AIは、私たちの生活を豊かにしてくれる可能性を秘めた技術です。

しかし、同時に多くのリスクも伴っています。これらのリスクをしっかりと認識し、適切な対策を講じることで、生成AIを安全に活用していくことが重要です。

こんな感じでした。

ChatGPTとGemini共々、当たり前ですが、リスクについての認識・対策は理解している。

そして、利用者に対し「賢く使え」と、言われているような気がします(私だけ?)。

以上、管理人のぼやきでした。

※Gemini(google ai)の記事を載せると、SCには登録できないみたいですね。

このようなニュースを聞くと、AIシステムの脆弱性が深刻な問題であることを再認識します。 生成AI(ChatGPTやGeminiなど)は、その性質上、大量のデータから学習し、 人間のように会話したり情報を生成したりする能力を持っています。

しかし、このような強力な機能は、悪意を持つ者にとっても魅力的な標的になり得ます。 サイバー攻撃やセキュリティの脅威は、今や現実の世界で深刻なリスクとなっています。 生成AIが攻撃の標的にされると、様々な問題が生じ得ます。

情報流出によって個人や企業の機密情報が漏洩する可能性や、不正な操作によって偽の 情報が生成される可能性があります。 このような状況に対処するためには、生成AIシステムのセキュリティ強化が必要不可欠です。

セキュリティ対策の強化や監視体制の整備、さらには法的規制の導入など、 様々なアプローチが必要です。 また、ユーザーもセキュリティに対する意識を高め、安全な利用方法を学ぶ必要があります。